PyTorch入门学习:1-Overview

这是PyTorch入门学习系列文章的第一篇,主要介绍PyTorch的基本概念。 本系列文章属于个人笔记,参考课程为PyTorch入门学习。

0. 一些闲话

0.1 版本问题:技术教学滞后性

1. 学习目标

- 使用PyTorch实现学习系统

- 理解神经网络/深度学习的基础

- 要求:

- Python

- 基本的数学知识(线性代数、微积分)

2. 什么是智能?

2.1 Human Intelligence

- Infer

- predict 数据->大脑->决策

2.2 Machine Intelligence

数据->模型->决策 数据训练->模型

- Machine Learning 算法与传统算法的区别:算法是基于数据的,而不是基于规则、人工设计的。

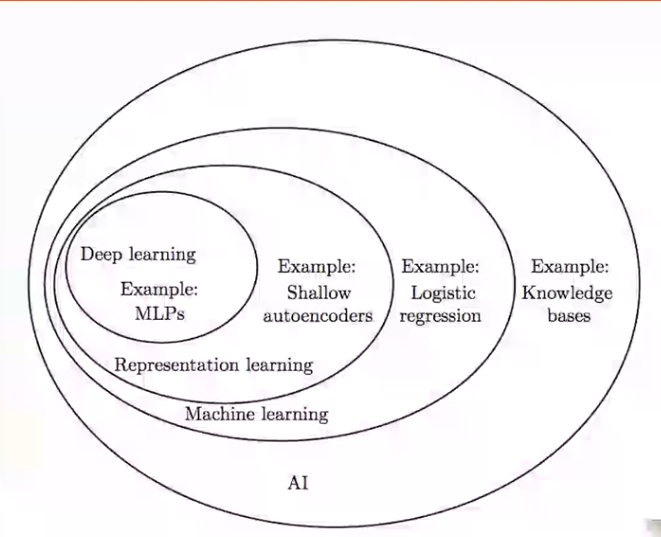

- Machine Learning 与 AI 的关系:

3. 概念

3.1 How to develop learning system?

- Rule-based system: Input->Hand-designed program->Output

- Classic Machine Learning: Input->Hand-designed

features->Mapping from features->Output

- 特征提取:手动设计特征提取函数,将输入数据转换为特征向量。

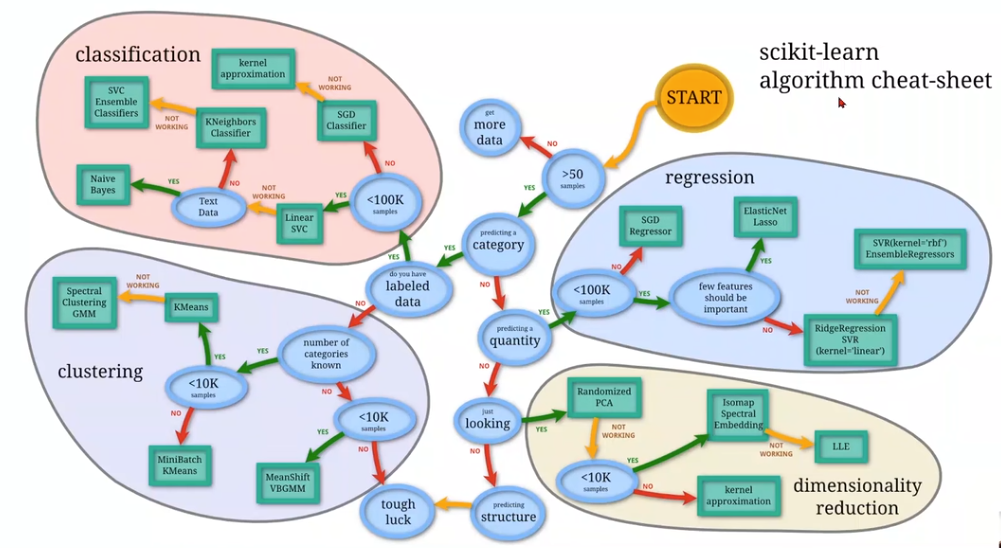

- 映射函数:使用数学模型(如线性回归、逻辑回归、支持向量机等)将特征向量映射到输出空间。

- Representation Learing: Input->Features->Mapping from

features->Output

- 为什么要进行特征提取? 维度诅咒:当特征空间维度增加时,训练数据的数量需求会指数级增加,导致模型训练变得非常困难。

- manifold(流形) learning:通过学习数据的低维表示,将高维数据映射到低维空间,保留数据的结构和信息。比如说银河系虽然是三维的,但是他的形状近似一个平面,因此可以用二维向量表示。(可微曲面均可)

- Deep Learning: Input->Simple features->Additional layers of more abstract features->Output 传统的表示学习特征提取的训练和学习机的学习是分开的。 而深度学习将这两个过程合并在一起,直接从原始输入数据学习到抽象特征表示,因此深度学习也被称为端到端学习(end-to-end learning)。

3.2 Traditional Machine Learning strategy

Shorts:

Shorts:

- 手工特征的限制

- SVM不能很好地处理大数据集

- 越来越多的应用需要处理非结构数据 一个较好的事例:ImageNet

4. Deep Learning

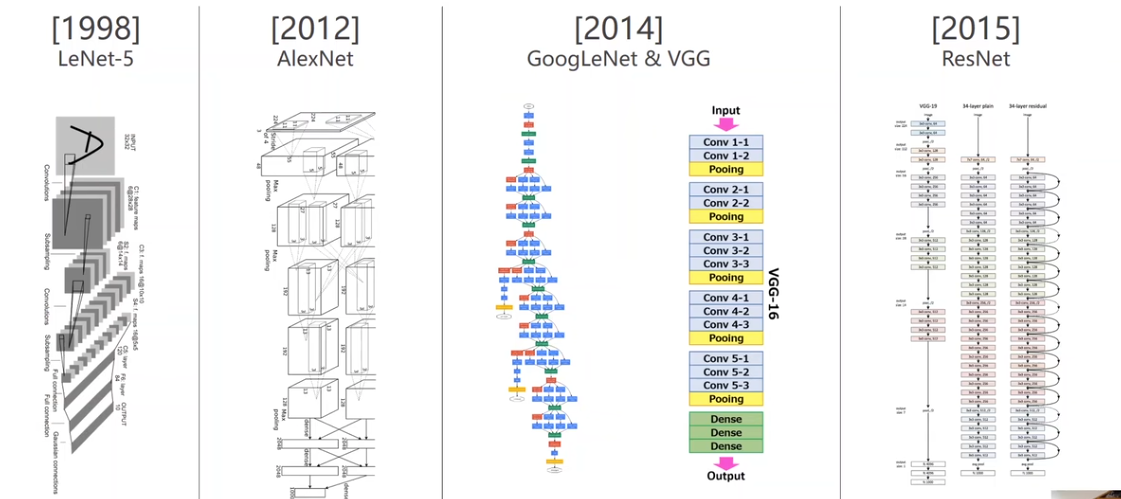

4.1 Brief history of neural networks

寒武纪物种的爆发:得益于神经系统的出现

生物学实验证明大脑视觉系统分层,每个层级负责处理不同的特征,对人工智能的发展有重要意义。

神经元:生物神经元是信息处理的基本单位,负责接收输入信号、处理信息并产生输出信号。

神经网络:人工神经元网络是模拟生物神经元的计算模型,由多个神经元层组成,每个神经元层负责处理不同的特征。

perceptron:最简单的神经网络模型,由一个输入层、一个输出层和一个或多个隐藏层组成。每个神经元都有一个权重向量和一个偏置项,通过加权求和和激活函数产生输出。

反向传播(backpropagation):一种用于训练神经网络的算法,通过计算损失函数对每个权重的梯度,来更新权重以最小化损失函数。

图为经典的神经网络模型

4.2 Good news & Why PyTorch?

PyTorch入门学习:1-Overview

https://eleco.top/2026/02/23/learn-torch-1-Overview/